La Polizia si affida all'IA per la prevenzione dei reati

“Giove” è il nuovo algoritmo di intelligenza artificiale che potrebbe rivoluzionare l'approccio alla sicurezza pubblica, ma solleva dubbi sulla privacy

di Francesco Pungitore*

Dal ministero dell'Interno emerge un progetto ambizioso che potrebbe ridefinire la strategia di prevenzione dei reati in Italia. Il nome in codice del progetto è “Giove”, un algoritmo di intelligenza artificiale destinato a tutte le questure del Paese, con l'obiettivo di “prevenire e reprimere” i crimini di maggior impatto sociale.

Giove rappresenta una evoluzione di Keycrime, un progetto iniziato nel 2008 presso la Questura di Milano, focalizzato principalmente sulla prevenzione delle rapine in ambito commerciale. Con l'aggiunta dell'intelligenza artificiale, il ministero dell'Interno spera di ampliare l'applicazione del software anche ad altri crimini, come molestie e violenze sessuali, furti in abitazione, truffe e raggiri.

Tecnicamente, Giove è “un sistema di elaborazione e analisi automatizzata per l'ausilio alle attività di polizia”. Utilizzando i dati storici sui reati, l'algoritmo tenta di predire dove e quando potrebbero verificarsi nuovi crimini. Questa strategia di “polizia predittiva” ha suscitato entusiasmo tra le forze dell'ordine, ma anche preoccupazione tra coloro che si occupano della protezione dei dati e della privacy.

Secondo Francesco Messina, direttore centrale Anticrimine della Polizia di Stato, Giove permette il cosiddetto “crime linking”, ovvero l'associazione di crimini basata sulle similarità tra i reati commessi. Questo potrebbe permettere alle forze dell'ordine di individuare più facilmente i responsabili di una serie di crimini correlati. Tuttavia, rimangono dei dubbi sulla validità di quest'approccio, con ricerche che mettono in discussione la sua efficacia e la sua tendenza a basarsi su pregiudizi.

Infatti, alcune critiche sollevano la questione dei pregiudizi algoritmici legati all'etnia e alla provenienza geografica delle persone. Inoltre, l'utilizzo di un sistema del genere potrebbe violare il diritto alla privacy e alla libertà individuale. Per questo, il Garante della privacy sta valutando la situazione.

Per quanto promettente, rimangono molte domande senza risposta riguardo a Giove. Non è chiaro quali dati verranno utilizzati per addestrare l'algoritmo, se le vittime dei reati saranno coinvolte nel processo, o come verranno gestiti e protetti i dati personali.

Sebbene si stia ancora lavorando per rispondere a queste domande, una cosa è certa: Giove rappresenta un passo significativo verso l'incorporazione dell'intelligenza artificiale nelle forze dell'ordine, aprendo una nuova era di prevenzione dei reati. Questo cambio di paradigma porta con sé sia le promesse dell'innovazione tecnologica, sia i dubbi e le sfide legate alla protezione dei diritti civili. Nel frattempo, il dibattito su come bilanciare efficacemente queste due priorità continua.

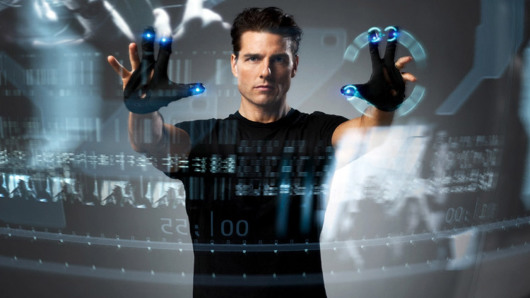

Da Minority Report a Giove, dal Cinema alla realtà

Il film “Minority Report”, diretto da Steven Spielberg nel 2002 e tratto dal racconto di Philip K. Dick, presenta uno scenario futuristico che offre un perfetto punto di discussione per la prevenzione dei reati nella società contemporanea. Ambientato nel 2054, il film ritrae una Washington D.C. dove la prevenzione dei reati non è solo possibile, ma è diventata la norma, grazie a un sistema chiamato Precrimine.

Il sistema Precrimine, che si basa sulle premonizioni di tre individui dotati di poteri extrasensoriali, i Precog, consente alla polizia di prevenire gli omicidi prima che essi si verifichino, arrestando i potenziali “colpevoli”. Questo scenario mette in risalto la questione etica della punizione basata sull'intenzione di compiere un reato, piuttosto che sull'atto stesso.

Tuttavia, il film si sviluppa intorno a un problema intrinseco di questo sistema: l'incapacità di essere infallibile. Viene infatti rivelato l'esistenza di un “rapporto di minoranza”, una previsione alternativa creata quando uno dei Precog vede un futuro diverso dagli altri. Questa rivelazione mette in dubbio l'infallibilità del sistema Precrimine e introduce la possibilità di errori o manipolazioni.

Questa tematica è particolarmente pertinente nell'era attuale, dove l'innovazione tecnologica ci porta sempre più vicini alla realizzazione di sistemi di sorveglianza e prevenzione dei reati sofisticati come quello ritratto in “Minority Report”. A livello sociale e legale, si pone la questione di come bilanciare l'uso di queste tecnologie per la prevenzione dei reati con il rispetto dei diritti civili e delle libertà individuali.

Il film offre una prospettiva critica su questo dilemma, presentando una storia in cui il protagonista, John Anderton, viene ingiustamente accusato di un crimine futuro a causa di un errore del sistema Precrimine. La sua lotta per dimostrare la sua innocenza evidenzia le possibili ingiustizie che potrebbero derivare da un sistema di prevenzione dei reati troppo affidato alla tecnologia e privo di un adeguato controllo umano.

In conclusione, “Minority Report” funge da monito sulle possibili implicazioni di una società che privilegia la prevenzione dei reati a discapito della presunzione di innocenza e della tutela dei diritti individuali. Anche se la tecnologia può offrire strumenti potenzialmente rivoluzionari per combattere la criminalità, il film ci ricorda l'importanza di affrontare con cautela queste innovazioni, garantendo che esse non compromettano le libertà fondamentali su cui si basa la nostra società.

Il predictive policing nel mondo

Oltre a numerose applicazioni negli Stati Uniti, l'uso del predictive policing riguarda anche molte parti del mondo, grazie all'implementazione di algoritmi predittivi e all'analisi di dati socio-demografici dei cittadini.

Un esempio significativo è l'Olanda, dove il predictive policing è stato utilizzato in un progetto chiamato “CasaRossa”. Qui, le forze dell'ordine utilizzano modelli di machine learning per identificare le proprietà che sono maggiormente a rischio di essere utilizzate per la coltivazione di marijuana. Il sistema esamina una serie di fattori, come l'età dell'edificio, il prezzo di vendita e l'ubicazione geografica, per determinare la probabilità di illegalità. Questo metodo ha permesso alla polizia di concentrare i propri sforzi su aree ad alto rischio, migliorando l'efficienza e la precisione delle indagini.

Anche in Giappone, l'utilizzo di tecniche di predictive policing ha portato a un notevole progresso. Un esempio è la polizia di Kyoto, che ha adottato un sistema di intelligenza artificiale per prevedere i luoghi e gli orari in cui è più probabile che si verifichino furti in appartamento. Il sistema, chiamato “Predictive Crime System”, utilizza dati storici sui crimini, oltre a vari fattori socio-demografici, per creare previsioni. Questa tecnologia ha portato a un aumento del tasso di arresti e a una riduzione dei furti.

In Australia, la polizia del Nuovo Galles del Sud ha lanciato un progetto chiamato “Suspect Targeting Management Plan” (STMP). Questo programma utilizza algoritmi per identificare gli individui a rischio di reiterare comportamenti criminali, basandosi su una serie di fattori tra cui la storia criminale, l'età, il sesso e l'ubicazione geografica. Questo sistema ha portato a un dibattito intenso a causa delle implicazioni etiche legate alla profilazione predittiva e al possibile impatto sulle comunità vulnerabili.

Questi sono solo alcuni esempi di come il predictive policing venga utilizzato nel mondo. Tuttavia, è importante sottolineare che l'uso di tali tecniche di previsione comporta anche una serie di questioni etiche e di privacy. Se da un lato queste tecniche possono migliorare l'efficienza delle forze di polizia e prevenire i crimini prima che accadano, dall'altro possono portare a discriminazioni sistematiche e alla violazione dei diritti civili. È quindi fondamentale implementare tali tecnologie con attenzione, bilanciando i benefici in termini di sicurezza con il rispetto per la privacy e la libertà dei cittadini.

*giornalista professionista, docente di Filosofia, Storia, Scienze Umane e Tecniche della Comunicazione con Perfezionamento post-laurea in Tecnologie per l’Insegnamento e Master in Comunicazione Digitale